Un sistem de camere care foloseste AI si recunoasterea faciala menit sa dezvaluie stari de emotie a fost testat pe uiguri din Xinjiang. Un inginer de software a sustinut ca a instalat astfel de sisteme in sectiile de politie din provincie.

Un avocat al drepturilor omului caruia i s-au aratat dovezile a descris-o ca fiind socanta.

Ambasada Chinei la Londra nu a raspuns direct la revendicari, insa afirma ca drepturile politice si sociale din toate grupurile etnice sunt garantate. Xinjiang gazduieste 12 milioane de uiguri minoritari etnici, dintre care majoritatea sunt musulmani.

Cetatenii din provincie sunt supravegheati zilnic. Zona gazduieste, de asemenea, ,,centre de reeducare” foarte controversate, numite lagare de detentie de inalta securitate de catre grupurile pentru drepturile omului, unde se estimeaza ca au fost retinute peste un milion de persoane.

Beijingul a sustinut intotdeauna ca supravegherea este necesara in regiune, deoarece spune ca separatistii care doresc sa-si infiinteze propriul stat au ucis sute de oameni in atacuri teroriste.

Inginerul de software a fost de acord sa discute cu programul BBC Panorama sub conditia anonimatului, deoarece se teme pentru siguranta sa. Nici compania la care a lucrat nu este dezvaluita.

Dar el i-a aratat Panoramei cinci fotografii ale detinutilor uiguri despre care a afirmat ca au testat sistemul de recunoastere a emotiilor.

„Guvernul chinez foloseste uigurii ca subiecti de testare pentru diferite experimente la fel cum sobolanii sunt folositi in laboratoare”, a spus el.

Si-a subliniat rolul sau in instalarea camerelor in sectiile de politie din provincie: „Am plasat camera de detectare a emotiilor la 3m de subiect. Este similar cu un detector de minciuni, dar tehnologie mult mai avansata.”

El a spus ca ofiterii folosesc ,,scaune de retinere” care sunt instalate pe scara larga in sectiile de politie din toata China.

,,Incheieturile tale sunt blocate la locul lor prin intermediul unor sisteme de retinere din metal si [acelasi lucru se aplica gleznelor”.

El a furnizat dovezi ale modului in care sistemul AI este instruit pentru a detecta si analiza chiar modificari minuscule ale expresiilor faciale si ale porilor pielii.

Potrivit afirmatiilor sale, software-ul creeaza o diagrama circulara, segmentul rosu reprezentand o stare de spirit negativa sau anxioasa.

El a sustinut ca software-ul este destinat ,,judecatii prealabile fara nicio dovada credibila”.

Ambasada Chinei la Londra nu a raspuns la intrebarile referitoare la utilizarea software-ului de recunoastere emotionala in provincie, dar a spus: ,,Drepturile politice, economice si sociale si libertatea credintei religioase in toate grupurile etnice din Xinjiang sunt pe deplin garantate.

,,Oamenii traiesc in armonie indiferent de mediul lor etnic si se bucura de o viata stabila si pasnica, fara restrictii la libertatea personala”.

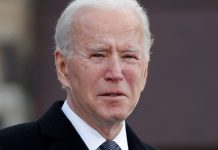

Dovezile i-au fost aratate lui Sophie Richardson, directorul chinez al Human Rights Watch.

„Este un material socant. Nu doar ca oamenii sunt redusi la o diagrama circulara, ci oamenii care se afla in circumstante extrem de coercitive, sub o presiune enorma, sunt intelegatori nervosi si sunt considerati ca un indiciu de vinovatie si cred ca este profund problematic.”

Comportament suspect

Potrivit lui Darren Byler, de la Universitatea din Colorado, uigurii trebuie sa furnizeze in mod obisnuit mostre de ADN catre oficialii locali, sa fie supusi scanarilor digitale si majoritatea trebuie sa descarce o aplicatie guvernamentala de telefonie, care colecteaza date, inclusiv liste de contacte si mesaje text.

„Viata uigura este acum despre generarea de date”, a spus el.

„Toata lumea stie ca smartphone-ul este ceva pe care trebuie sa-l duci cu tine si, daca nu il poti purta, poti fi retinut, stiu ca esti urmarit de el. Si au impresia ca nu exista nicio scapare”, a spus el.

Majoritatea datelor sunt introduse intr-un sistem informatic numit Platforma Integrata de Operatiuni Comune, despre care Human Rights Watch sustine un comportament presupus suspect.

„Sistemul colecteaza informatii despre zeci de tipuri diferite de comportamente perfect legale, inclusiv lucruri precum daca oamenii ieseau pe usa din spate in loc de usa din fata, daca puneau benzina intr-o masina care nu le apartinea”, a spus Doamna Richardson.

,,Autoritatile plaseaza acum coduri QR in afara usilor caselor oamenilor, astfel incat sa poata sti cu usurinta cine ar trebui sa fie acolo si cine nu”.

De mult timp s-a dezbatut despre cat de strans legate de firmele de tehnologie chineze sunt de stat. Grupul de cercetare din SUA, IPVM, sustine ca a descoperit dovezi in brevetele depuse de astfel de companii care sugereaza ca produsele de recunoastere faciala au fost concepute special pentru a identifica oamenii uiguri.

Un brevet depus in iulie 2018 de Huawei si Academia de Stiinte din China descrie un produs de recunoastere a fetei care este capabil sa identifice persoanele pe baza etniei lor.

Huawei a spus ca raspuns ,,nu a acceptat utilizarea tehnologiei pentru a discrimina sau a asupri membrii vreunei comunitati” si ca este ,,independenta de guvern” oriunde a functionat.

Grupul a gasit, de asemenea, un document care pare sa sugereze ca firma dezvolta tehnologie pentru asa-numitul sistem One Person, One File.

„Pentru fiecare persoana, guvernul isi stocheaza informatiile personale, activitatile sale politice, relatiile … orice ar putea sa va ofere o perspectiva asupra modului in care persoana respectiva s-ar comporta si ce fel de amenintare ar putea reprezenta”, a spus Conor Healy al IPVM.

„Face orice tip de disidenta potential imposibil si creeaza o predictibilitate adevarata pentru guvern in comportamentul cetatenilor lor. Nu cred ca [George] Orwell si-ar fi imaginat vreodata ca un guvern ar putea fi capabil de acest tip de analiza”.

Huawei nu a abordat in mod specific intrebarile legate de implicarea sa in dezvoltarea tehnologiei pentru sistemul One Person, One File, dar a repetat ca este independent de guvern oriunde a functionat.

Ambasada chineza la Londra a declarat ca nu ,,cunoaste” aceste programe.

IPVM a sustinut, de asemenea, ca a gasit materiale de marketing de la firma chineza Hikvision care promoveaza o camera AI care detecteaza uigur si un brevet pentru software dezvoltat de Dahua, un alt gigant tehnologic, care ar putea identifica si uigururile.

Dahua a declarat ca brevetul sau se refera la toate cele 56 de etnii recunoscute in China si nu a vizat in mod deliberat pe niciuna dintre ele.

Acesta a adaugat ca a furnizat ,,produse si servicii care au scopul de a ajuta la mentinerea in siguranta a oamenilor” si a respectat ,,legile si reglementarile fiecarei piete” pe care isi desfasoara activitatea, inclusiv Marea Britanie.

Hikvision a spus ca detaliile de pe site-ul sau web erau incorecte si ,,incarcate online fara o revizuire adecvata”, adaugand ca nu a vandut sau nu are in gama sa de produse ,,o functie de recunoastere minoritara sau o tehnologie de analiza”.

Dr. Lan Xue, presedintele comitetului national chinez pentru guvernarea AI, a declarat ca nu este la curent cu brevetele.

„In afara Chinei exista o multime de acuzatii de acest gen. Multe nu sunt exacte si nu sunt adevarate”, a declarat el.

„Cred ca guvernul local din Xinjiang a avut responsabilitatea de a proteja cu adevarat oamenii din Xinjiang … daca tehnologia este utilizata in aceste contexte, este destul de inteles”, a spus el.